Искусственный интеллект как объект повышенной опасности:

правовой анализ в контексте статьи 1079 ГК РФ

Стремительное развитие технологий искусственного интеллекта (далее – ИИ) трансформирует все сферы человеческой деятельности. В Российской Федерации развитие искусственного интеллекта регулируется Национальной стратегией развития искусственного интеллекта на период до 2030 года, которая формирует основы в данной сфере. Вопросы, связанные с правовым регулирование технологии искусственного интеллекта, можно разделить на две группы: определение правового режима технологии и предупреждение последствий. Наряду с неоспоримыми преимуществами, широкое внедрение ИИ-систем порождает новые риски для жизни, здоровья и имущества граждан, а также для общественной безопасности, что неоспоримо ведет к пересмотру позиции законодателя по вопросам ответственности лиц за причинение вреда. В свете этого возникает фундаментальный правовой вопрос: можно ли отнести системы искусственного интеллекта к категории источников повышенной опасности (далее – ИПО) по смыслу статьи 1079 Гражданского кодекса Российской Федерации (ГК РФ)? Данная статья посвящена комплексному анализу этой проблемы, исследованию критериев применимости ст. 1079 ГК РФ к технологии искусственного интеллекта и выявлению правовых последствий такой квалификации, а также сравнению данного подхода с подходом по наделению технологии правосубъектностью.

Источники повышенной опасности: правовая природа и критерии

Статья 1079 ГК РФ устанавливает особый режим ответственности для владельцев источников повышенной опасности. Объектом регулирования выступает деятельность, связанная с эксплуатацией объектов или осуществлением иной деятельности, создающей повышенную опасность для окружающих. К субъектам ответственности относятся юридическое лицо или граждане, которые владеют источником повышенной опасности на праве собственности, праве хозяйственного ведения или праве оперативного управления либо на ином законном основании (например, на праве аренды, доверенности на управление транспортным средством).

Основаниями ответственности являются факты причинения вреда деятельностью, связанной с эксплуатацией источника повышенной опасности. Ответственность наступает независимо от вины владельца. Это ключевая особенность – владелец отвечает даже если докажет, что сделал все возможное для предотвращения вреда (например, соблюдал все инструкции). Однако существуют случаи освобождения от ответственности владельца источника повышенной опасности, а именно:

- если будет доказано, что вред возник вследствие непреодолимой силы;

- если будет доказано, что вред возник вследствие умысла потерпевшего.

Необходимо уделить внимание критериям отнесения к источникам повышенной опасности:

- высокая степень потенциальной вредоносности;

- невозможность полного контроля со стороны человека: даже при самом тщательном соблюдении всех правил безопасности полностью исключить риск причинения вреда невозможно в силу внутренних свойств объекта/деятельности. Риск является имманентным (неотъемлемым);

- широкий круг потенциальных потерпевших: опасность угрожает неопределенному кругу лиц (окружающим).

Искусственный интеллект: потенциал опасности

Системы искусственного интеллекта обладают характеристиками, которые создают потенциал для причинения вреда, сопоставимого с традиционными источниками повышенной опасности:

автономность: способность принимать решения и выполнять действия без прямого и постоянного вмешательства человека. Чем выше степень автономности, тем меньше возможность мгновенного человеческого контроля в критической ситуации;

сложность и «черный ящик»: алгоритмы глубокого обучения, лежащие в основе многих современных ИИ, чрезвычайно сложны. Даже их разработчики не всегда могут до конца понять и предсказать, как система придет к тому или иному решению в конкретной ситуации, особенно при столкновении с данными, не представленными в обучающей выборке (проблема «черного ящика»). Это затрудняет прогнозирование и предотвращение вредоносных действий;

зависимость от данных: качество и релевантность данных напрямую влияют на его решения. Некорректные, предвзятые или устаревшие данные могут привести к ошибочным и потенциально опасным выводам. Уязвимость к преднамеренной «атаке» на данные (“adversarial attack”) также создает риски;

адаптивность и непредсказуемость: способность ИИ к самообучению и адаптации в реальном времени увеличивает непредсказуемость его поведения в долгосрочной перспективе и при взаимодействии со сложными, динамично меняющимися средами.

Применимость ст. 1079 ГК РФ к системам ИИ: анализ критериев

Можно ли утверждать, что эксплуатация систем ИИ подпадает под действие ст. 1079 ГК РФ? Рассмотрим ключевые критерии.

Высокая степень потенциальной вредоносности: например, сбой ИИ-системы диагностики, приведший к неправильному лечению. Следовательно, критерий выполняется для широкого класса ИИ-систем, особенно используемых в физическом мире или при управлении критически важными процессами.

Невозможность полного контроля со стороны человека – это самый дискуссионный и важный критерий.

Аргументы «за»: автономность искусственного интеллекта означает, что человек не контролирует каждый шаг системы в реальном времени. Сложность алгоритмов и «черный ящик» делают невозможным полное предвидение всех возможных сценариев работы искусственного интеллекта и их последствий. Даже при идеальном соблюдении всех инструкций разработчиком и оператором, риск нештатной ситуации из-за внутренней логики искусственного интеллекта или уникального стечения внешних обстоятельств полностью исключить нельзя. Риск имманентен самой природе сложных самообучающихся систем.

Аргументы «против»: искусственный интеллект создается и внедряется людьми. Контроль осуществляется на этапах проектирования, тестирования, установки ограничений (“guardrails”), мониторинга и возможности вмешательства (“override”). Если вред вызван ошибкой программирования, недостаточным тестированием или халатностью оператора – это вина конкретных лиц, а не имманентный риск.

Широкий круг потенциальных потерпевших: эксплуатация ИИ в публичных сферах (транспорт, медицина, финансы) по определению создает угрозу для неопределенного круга лиц – пассажиров, пациентов, вкладчиков, пешеходов и других. Следовательно, критерий выполняется.

Таким образом, сложные автономные системы искусственного интеллекта, эксплуатация которых связана с физическим взаимодействием с окружающим миром или управлением критически важными процессами, обладают всеми признаками источника повышенной опасности в трактовке ст. 1079 ГК РФ.

Сравнение концепций правового регулирования технологий искусственного интеллекта как объекта (источник повышенной опасности) права и субъекта права (электронное лицо)

Для полного раскрытия темы необходимо уделить внимание сравнению концепций правового регулирования технологии искусственного интеллекта, которые преобладают в исследуемой сфере, а именно рассмотрение технологии искусственного лица как объекта и рассмотрение технологии искусственного интеллекта как субъекта права, в соответствии с теорией О.А. Ястребова.

Подход к технологии искусственного интеллекта как к источнику повышенной опасности основан на положениях ст. 1079 ГК РФ и предполагается «безвинную» ответственность за вред, если не доказано непреодолимую силу или умысел потерпевшего. Для его применения необходимо соответствие ряду критериев, в частности, признание высокой вредоносности, отсутствие возможности полного контроля человеком, угроза неопределенному кругу лиц. Ответственность возлагается на владельца технологии (разработчик, оператор), что стимулирует инкорпорацию страховых механизмов и стандартов безопасности.

В свою очередь, понимание технологии искусственного интеллекта как самостоятельного субъекта права («электронного лица») предполагает более масштабные изменения в российском законодательстве. Наделение технологии искусственного интеллекта ограниченной правосубъектностью по аналогии с юридическим лицом позволит переложить ответственность за вред, причиненный технологией, а также вопрос обладания правами (например, авторскими). Концепция «электронного лица» предполагает наделение технологии критериями разумности: наличие воли, сознания, возможно, эмоций. Несмотря на прецеденты по «наделению» технологии признаками субъекта права, данная концепция представляется жизнеспособной исключительно для теоретического осознания, по крайней мере, на сегодняшний день.

При сравнении специфики ответственности выявляются отличия в сторонах: так при рассмотрении технологии как источника повышенной опасности ответственность возложена на владельца технологии, в то время как концепция «электронного лица» предполагает ответственность самой технологии. Возмещение вреда осуществляется через страхование, создание компенсационных фондов, в случае «электронного лица» имущество искусственного интеллекта формируется посредством отчислений разработчиков. Доказывание вины, при рассматривании технологии искусственного интеллекта как источника повышенной опасности, не требуется (достаточно причинной связи), что отличается от установления «вины» при концепции «электронного лица», при которой необходима «виновность» технологии искусственного интеллекта в рамках его алгоритмических решений.

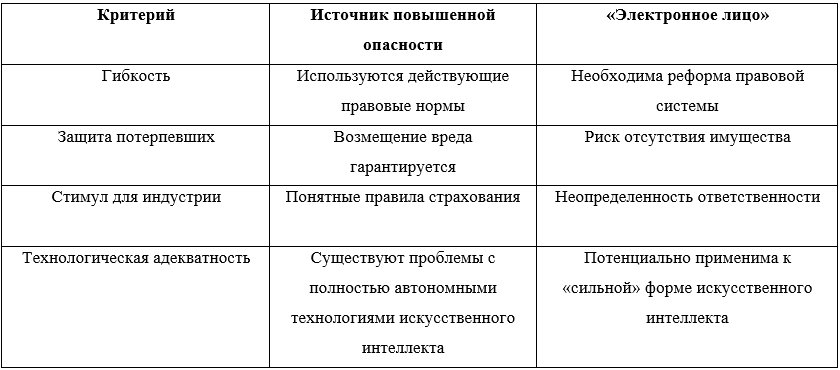

Представляется возможным сравнить подходы по критериям:

Правовые последствия признания ИИ источником повышенной опасности

Если суд квалифицирует конкретную ИИ-систему как ИПО, это влечет за собой следующие последствия:

- Ответственность владельца независимо от вины: владелец системы будет обязан возместить вред, причиненный этой системой, даже если невиновен в происшествии. Ему придется доказывать либо непреодолимую силу (крайне маловероятно для сбоя ИИ, который обычно не является «чрезвычайным» и «непредотвратимым» событием), либо умысел потерпевшего.

- Смещение бремени доказывания: потерпевший должен доказать факт причинения вреда, размер вреда и причинно-следственную связь между эксплуатацией ИИ-системы и наступившим вредом. Доказывать отсутствие своей вины или наличие обстоятельств для освобождения от ответственности (непреодолимая сила, умысел потерпевшего) должен владелец ИИ.

- Стимул для владельцев: осознание строгой ответственности будет стимулировать владельцев ИИ к:

- тщательному выбору поставщиков ИИ;

- инвестициям в самые современные системы безопасности, тестирование и валидацию;

- постоянному мониторингу работы ИИ;

- обязательному страхованию гражданской ответственности за причинение вреда ИИ;

- разработке и неукоснительному соблюдению протоколов безопасности.

- Сложности с определением «владельца»: в отношении технологии искусственного интеллекта установление владения может быть сложным - разработчик (создатель алгоритма и модели), интегратор (настраивающий систему под нужды), конечный пользователь-владелец (компания, эксплуатирующая ИИ), облачный провайдер (на чьей инфраструктуре работает ИИ). Потребуется четкое определение (судебное толкование), кто именно является «владельцем» для целей ст. 1079 ГК РФ в каждом конкретном случае эксплуатации. Возможна солидарная ответственность.

- Проблема «дефекта» искусственного интеллекта: если вред возник из-за скрытого дефекта в самом искусственном интеллекте, у владельца может возникнуть право регрессного требования к разработчику по общим нормам о возмещении вреда (ст. 1064 ГК РФ) или по договору. Но перед потерпевшим в соответствии со ст. 1079 ГК РФ отвечает именно владелец.

Проблемы и перспективы правового регулирования

Применение ст. 1079 ГК РФ к ИИ сталкивается с рядом вызовов. Во-первых, определение границ автономности: необходимы критерии, когда искусственный интеллект считается достаточно автономным для признания его источником повышенной опасности. Возможно, потребуется классификация искусственного интеллекта по уровням риска и автономности с разными режимами ответственности.

Во-вторых, «черный ящик» и установление причинно-следственной связи: потерпевшему сложно доказать, что вред вызван именно действием (бездействием) искусственного интеллекта, а не иными факторами или ошибкой человека. Требуются законодательные гарантии доступа к данным и логам работы искусственного интеллекта для расследования инцидентов.

В-третьих, распределение ответственности в цепочке создания стоимости искусственного интеллекта: необходима разработка механизмов разграничения ответственности между разработчиком, владельцем, оператором и другими участниками, особенно если вред вызван комбинацией факторов.

В-четвертых, необходимо применение инструментария страхования. Формирование рынка страхования ответственности за вред, причиненный технологией искусственного интеллекта, с адекватными тарифами, учитывающими риски разных типов систем.

В-пятых, существует объективная потребность в специальном законодательстве. Статья 1079 ГК РФ является общая норма. Для адекватного регулирования ответственности за вред от искусственного интеллекта, особенно в части определения владельца, стандартов безопасности, процедур расследования инцидентов и страхования, требуется развитие специального законодательства об искусственном интеллекте. К слову, проекты таких законов уже разрабатываются в РФ (например, концепция закона «Об искусственном интеллекте в Российской Федерации»).

Технологии искусственного интеллекта несут в себе значительный потенциал причинения вреда, сопоставимый с традиционными источниками повышенной опасности. Анализ критериев ст. 1079 ГК РФ позволяет сделать вывод, что сложные автономные ИИ-системы объективно подпадают под категорию источников повышенной опасности.

Признание этого факта влечет применение строгой (безвиновной) ответственности владельца такого ИИ. Это создаст мощный экономический стимул для внедрения самых высоких стандартов безопасности, тщательного тестирования, надежного мониторинга и обязательного страхования рисков. Однако существующее законодательство нуждается в развитии и конкретизации применительно к искусственному интеллекту. Требуется четкое определение «владельца» искусственного интеллекта – источника повышенной опасности, механизмы расследования инцидентов с участием «черных ящиков», развитие института страхования и, в перспективе, принятие комплексного закона, регулирующего вопросы ответственности за вред, причиненный искусственным интеллектом.

Без установления адекватного правового режима, включая потенциальное применение ст. 1079 ГК РФ, дальнейшее развитие и внедрение технологий искусственного интеллекта будет сопряжено с рисками. Признание искусственного интеллекта объектом повышенной опасности – необходимое условие для его безопасного и ответственного развития в правовом поле.